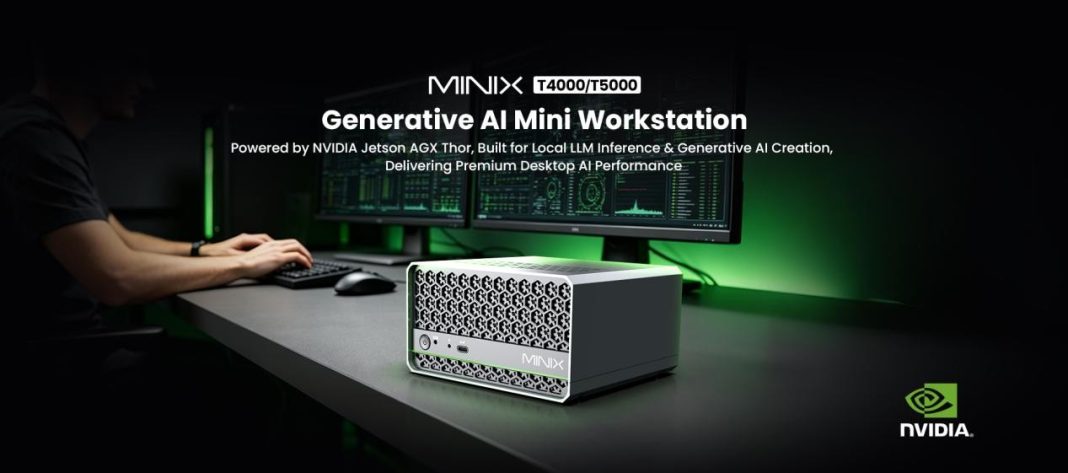

Prosesor yang Kuat & Memori Berkapasitas Tinggi

Untuk menghilangkan hambatan dalam pengoperasian model besar, T4000 / T5000 dilengkapi dengan prosesor Arm berinti banyak dan memori yang besar serta cepat:

• CPU Arm® Neoverse®-V3AE 64-bit dengan 12 inti (T4000) atau 14 inti (T5000)

• Hingga 128 GB LPDDR5X berbandwidth tinggi (4266 MHz, 273 GB/s)

• Ruang memori yang sangat besar untuk LLMs, AI multimodal, dan beban kerja bersamaan

Konektivitas Berkecepatan Tinggi & I/O yang Lengkap

Dirancang untuk alur kerja profesional, workstation mini ini dilengkapi dengan jaringan kelas perusahaan dan kemampuan ekspansi yang fleksibel:

• Dual 10GbE Ethernet untuk transfer data super cepat

• Wi-Fi 6E + Bluetooth 5.3 untuk konektivitas nirkabel yang stabil

• 2× HDMI 2.1 TMDS (4K@60 Hz) untuk dua layar beresolusi tinggi

• 4× USB 3.2 Gen 1 Tipe-A + 1× USB 3.2 Gen 2 Tipe-C

• Masukan DC 24V, daya maksimum hingga 200W

Kapasitas Penyimpanan Besar & Desain Ringkas

T4000 / T5000 menghadirkan keseimbangan antara performa, kapasitas penyimpanan, dan efisiensi ruang:

• SSD M.2 NVMe PCIe 4.0 1 TB (Dapat ditingkatkan hingga 4 TB)

• Dimensi ringkas: 139,3 × 131 × 76,8 mm

• Ringan: 1.420 g

• Sasis logam + plastik yang tahan lama

• Intercooler twin turbo untuk performa beban tinggi yang berkelanjutan

• Tidak memerlukan rak — pemasangan desktop plug-and-play

AI di Lokasi & Ekosistem Perangkat Lunak NVIDIA yang Lengkap

Keamanan, privasi, dan kompatibilitas menjadi inti dari desain T4000 / T5000:

• Penerapan lokal dan privat: Semua data dan model diproses langsung di perangkat, tanpa perlu mengunggah ke cloud

• Ubuntu 24.04 LTS (NVIDIA JetPack 7.1) sudah terinstal

• Dukungan penuh untuk CUDA, TensorRT, NIM, dan alur kerja AI berbasis kontainer

• Keandalan tingkat industri: Watchdog yang dapat diprogram dengan 255 tingkat, ketahanan ESD Tingkat 4, dan toleransi lingkungan yang luas

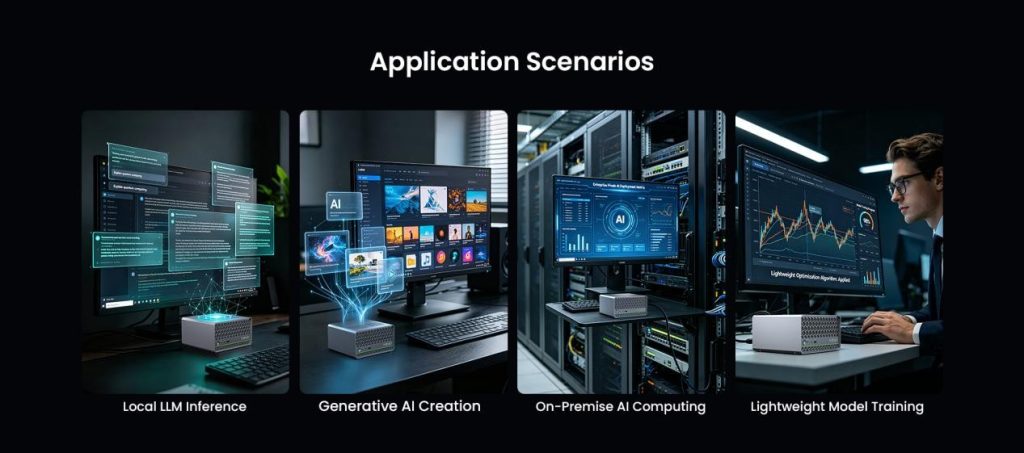

Ideal Use Cases

The MINIX T4000 / T5000 is built for professional generative AI workflows:

- Local LLM Inference: Private, low-latency AI chat, reasoning, and document processing

- Generative AI Creation: AI image, video, 3D, and digital content production

- On-Premise AI Computing: Enterprise private AI hub, secure team AI services

- Lightweight Model Training: LoRA fine-tuning, model distillation, and dataset processing